Anos atrás eu li o livro do Ray Kurzweil chamado A Era das Máquinas Espirituais, onde ele defendia que em 2029 os computadores seriam tão inteligentes quanto os humanos. Pensei “será”? Então li o segundo livro dele, o Singularity is Near e vi que ele já tinha abandonado qualquer rigor filosófico pelo hype científico.

Em vez de dizer para as pessoas quais eram as grandes dificuldades para se obter uma inteligência artificial geral com a tecnologia da época, ele preferiu assustar as pessoas com uma iminente e nunca realizada profecia de alguma descoberta tecnológica que iria criar uma IA autoconsciente e mais inteligente do que nós.

Vou tentar fazer agora o que eu esperava que um futurista deveria fazer: o que precisamos entender para superar a inteligência humana?

Para mim, são 3 grandes problemas:

Há certas características nos seres inteligentes que uma máquina deveria ser capaz de reproduzir para ser considerada “inteligente como nós”. Ela pode ter uma inteligência em outros sentidos, mas não será uma inteligência humana. A inteligência às vezes pode ser confundida com “raciocínio rápido”, “cultura”, “criatividade” etc, mas a rigor isso tudo são acessórios, meios, processos que o ser humano usa para aprimorar e desenvolver a sua inteligência.

1) A inteligência precisa reconhecer a verdade. Em uma automação industrial comum, é fácil programar uma máquina para quando certo peso não for atingido num produto. Um panetone, digamos, é descartado ou enviado para o setor de qualidade quando ele não atinge 500g. No entanto, esse peso pode ser chumbo, tênis ou um tamanduá-bandeira. Ela é incapaz de reconhecer a “verdade” do processo, pois lhe falta inteligência.

Da mesma forma, uma IA pode reconhecer um pedaço de salmão, como você vai ver abaixo, mas ela é incapaz de dizer se ele é verdadeiro ou não sem que você determine de antemão o que é e o que não é um “salmão verdadeiro” e um de porcelana. Quer dizer, uma IA é normalmente construída com base na sintaxe (a ordem das palavras, do pensamento e suas relações), mas ela ainda sofre com a semântica (o sentido das palavras) e a pragmática (o uso intencional e contextual dessas palavras). É por isso que o Chat GPT ainda sofre com paradoxos, piadas e ironia1. Um ser inteligente precisa dos três.

“Mas nós também podemos confundir algo falso com verdadeiro!”. Exato.

Aí entramos na segunda característica dos seres inteligentes:

2) O ser inteligente pode admitir a verdade se quiser. Que significa “admitir”? Significa ser livre para preferir a mentira ou um resultado falso e significa acreditar nesse resultado. Ao acreditar nesse resultado, “este salmão é verdadeiro”, ele assume para si a responsabilidade dessa crença. Se você disser que é um salmão verdadeiro e ele salmão não for, você pode ser processado, por exemplo. É muito difícil dizer que “a culpa é da IA” do modo como as coisas estão hoje. A culpa é sua que não usou a inteligência para discernir a verdade diante do material que ela apresentou (ou culpa de quem te vendeu algo falso).

Nesse sentido, apenas os seres livres e responsáveis são inteligentes. O ser humano é plenamente capaz de saber quanto está mentindo, quando está fingindo e até planejar fazer isso tudo apesar das consequências.

Mesmo que uma máquina escolha um caminho falso, ela só vái escolhê-lo se alguém assim decidir programá-la desa forma.

3) Só o ser humano é capaz do pensamento abdutivo. Esquisito?

Me diz aí: qual é a distância do seu braço até o teclado? ou quantos metros você percorre até atravessar a rua?

Tenho certeza de que você jamais calculou isso. Eu também não. Apesar disso, você tem atravessado a rua com segurança sem medir a velocidade dos carros. Não fazemos isso porque temos um radar interno que mede isso por nós. Temos um tipo especial de conhecimento chamado “abdução” pelo filósofo Charles Sanders Peirce ou “Estimação” como os medievais chamavam. É um tipo de “inferência” ou “intuição” se você quiser. Além da dedução e da indução, existe a abudção, que usamos o tempo todo.

A dedução é: “Está chovendo; portanto, as ruas estão molhadas.” Abdução é: “Eu sei que a chuva molha as ruas. Vejo que as ruas estão molhadas. Talvez esteja chovendo”. Você gera uma hipótese que explica uma observação. Não é um conhecimento certo – você pode estar errado. Talvez um cano tenha estourado ou umas crianças tenham brincado de pistolinha de água na rua.

No entanto, você continua corrigindo sua hipótese com observações adicionais. As ruas estão molhadas, minha hipótese é que está chovendo, e aí eu confirmo ou formo outra. Isso é abdução – geração de hipóteses que se autocorrigem à medida que novos fatos são descobertos. Você achou que dava para atravessar a rua, mas viu que os carros estavam passando muito rápido e decidiu esperar pelo melhor momento.

Sabe qual IA faz isso hoje? Nenhuma. Sabe por quê? Porque ninguém sabe como programar uma que possa fazer isso. Não se trata de “ter mais dados”. Pense num castelo de areia. Até certo ponto quanto mais areia você colocar, mais alto ele fica. Mas depois apenas 1 grão pode desfazer o trabalho de uma tarde inteira no Guarujá.

E não é como se não tivéssemos tentado.

Antes do deeplearning se tornar o paradigma dominante no desenvolvimento da IA, o design clássico da IA era mais baseado em regras. Um dos grandes desafios do paradigma clássico baseado em regras era, de fato, encontrar essas regras práticas, ou heurísticas.

Herbert Simon, um pioneiro em IA e vencedor do Prêmio Nobel de Economia, afirmou que as pessoas que defendem a adequação e a eficiência em detrimento da otimização geralmente tomam decisões melhores, mais responsáveis e mais rápidas do que aquelas que pretendem tomar todas as decisões perfeitas. Elas preferem estar mais ou menos certas a terem razão. A precisão pode ser uma barreira para a IA, como é para os humanos que a desenham.

No entanto, a abordagem clássica de IA baseada em heurísticas de bom senso também falhou quando o ambiente não era restrito. Mesmo que você tenha uma regra que não exige precisão, você tem tanto contexto em um ambiente irrestrito do mundo real que precisa de regras para informar outras regras quando elas são relevantes. Rapidamente se torna impossível tentar obter um comportamento inteligente nesse sistema.

Pense num robô andando pela Avenida Paulista. O terreno, o barulho, a confusão, as buzinas, são tantas informações imprevisíveis que ele em pouco tempo deixaria de funcionar. Tropeçaria nas calçadas esburacadas, trombaria com pedintes e ficaria horas conversando com os malucos nos becos achando que está dando informação.

Esses vídeos de robôs pulando e cozinhando impressionam, claro. Eu adoro. Mas impressionam por causa do ambiente controlado. Ninguém sabe como fazer isso sem supervisão num ambiente descontrolado. É por isso que você não vê robôs nas ruas.

Outro teste seria a navegação em ambientes dinâmicos por veículos autônomos ou robôs. Chegar à direção totalmente autônoma será muito mais difícil do que as pessoas pensam. A pequena cidade de Palo Alto, Califórnia, que é usada frequentemente para testes, está bem mapeada e você obtém um desempenho muito bom dos veículos de lá. Mas se você estiver dirigindo em uma estrada rural e a IA precisar confiar nos dados dos sensores, já era.

Em dois casos desencorajadores os carros autônomos frearam bruscamente quando folhas tocaram o sensor e um outro ao ver um ônibus alto tentou entrar embaixo dele achando que era um túnel.

Robótica totalmente capaz em ambientes dinâmicos abertos e com plena compreensão da linguagem natural ainda estão longe de acontecer.

Então por que o hype?

O matemático George Polya costumava brincar que se você não consegue resolver um determinado problema, encontre um problema mais fácil que você possa resolver. Este pode ser um bom conselho se o problema mais fácil que você pude resolver iluminar de forma significativa o problema mais difícil (de preferência, ajudando-o a resolver o problema mais difícil).

Mas a comunidade da IA tem usado esse raciocínio para ignorar os problemas difíceis para obter financiamento de milionários empolgados com a ideia de viver para sempre e de liderar essa nova era de automações invisíveis nos seus bunkers impenetráveis.

Tudo isso liderado por pessoas financiadas por essa mesma elite, como o Ray Kurzweil, empregado do Google e marqueteiro de fantasias nas horas vagas. Não é como se ele não soubesse dito. Esse é o problema insuperável da inteligência. Ela pode admitir a verdade — se quiser.

Nós precisamos urgentemente escolher melhor nossos modelos nos próximos anos.

GPT-4 agora é multimodal (nos EUA)

Na semana passada, a OpenAI anunciou que o DALL·E 3 seria disponibilizado no ChatGPT (só nos EUA por enquanto). Esta semana, eles anunciaram que finalmente adicionarão recursos de visão (e voz). Isso significa que você poderá fornecer uma imagem ao ChatGPT e interagir com ela. Eu também me pergunto como os recursos de visão afetarão a geração de imagens com o DALL·E. Se eles acertarem o aspecto da edição de imagens com linguagem natural (“torne essa imagem em preto e branco”, “coloque um cachorro no canto” etc), aí será de fato uma nova era.

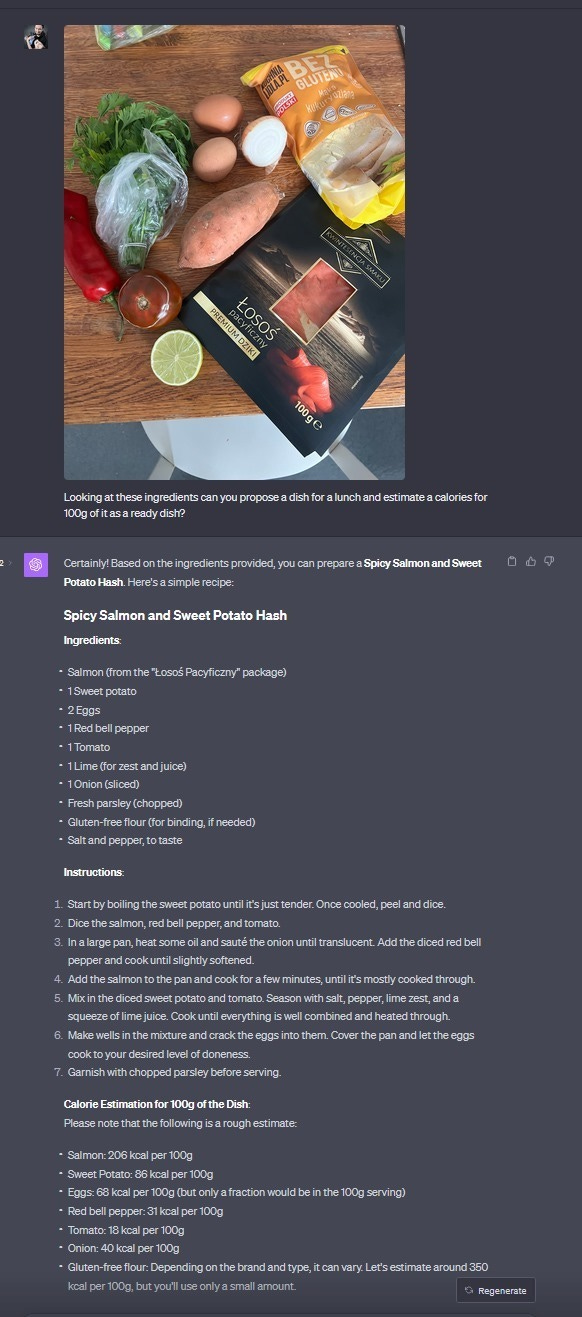

Na foto, um usuário tira foto de ingredientes e pede para o Chat GPT gerar uma receita, inclusive com as calorias.

DALL·E 3 and GPT-4V available for free on Bing

A Microsoft lançou discretamente o DALL·E 3 e o GPT-4V no Bing na semana passada e está disponível gratuitamente (por enquanto). O DALL·E 3 também pode ser usado no Bing Creator. Embora a qualidade da imagem não seja comparável ao Midjourney, ela gera resultados com uma granulação que eu aprecio, o que é difícil de obter no Midjourney.

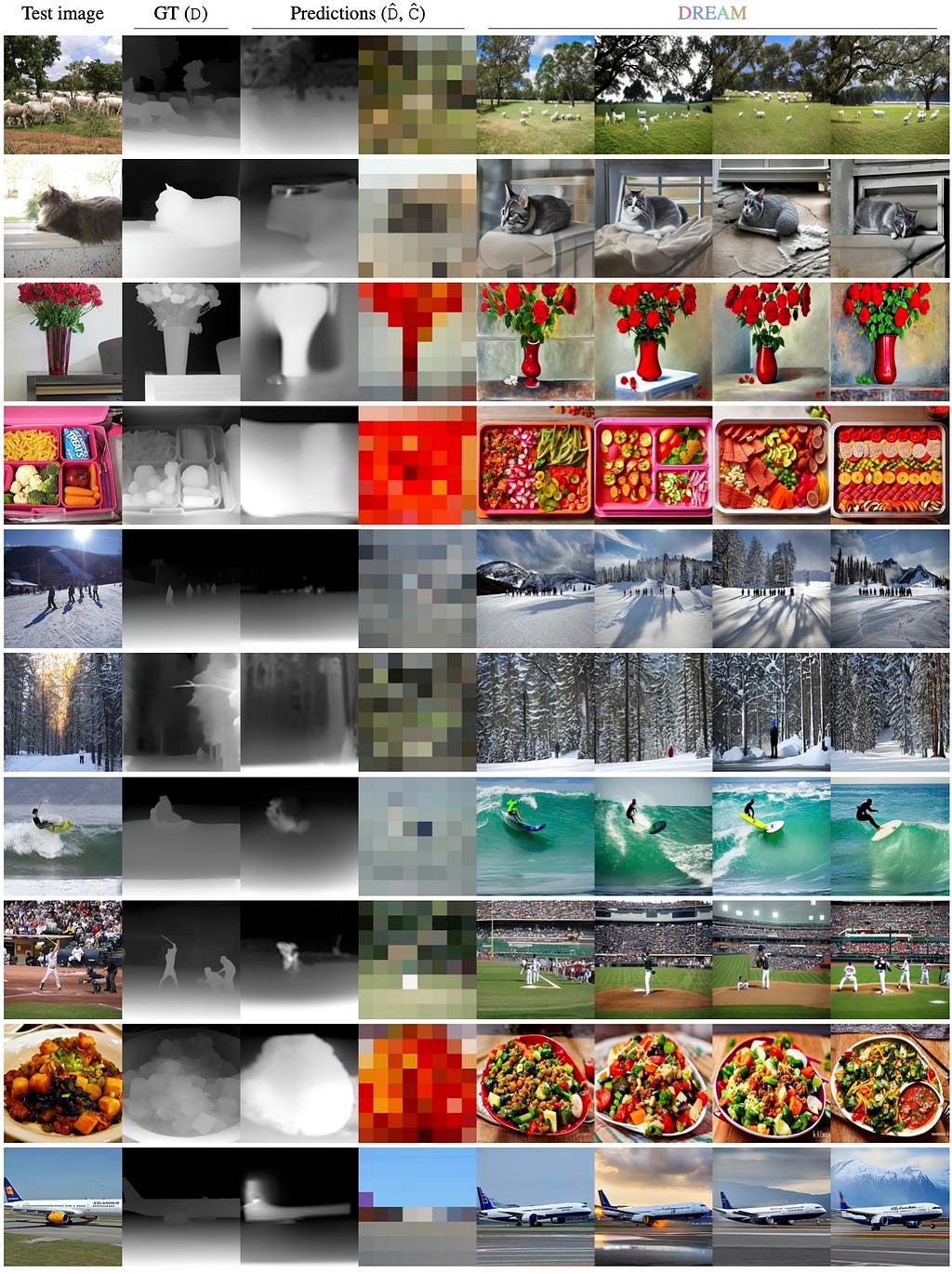

DREAM: Em breve vamos visualizar nossos sonhos

DREAM é um método de fMRI para imagem para reconstruir imagens visualizadas de atividades cerebrais. É um pré-processador capaz de converter suas ondas cerebrais em semântica, cores e mapas de profundidade para ControlNet.

FERRAMENTAR.IA

Relay - Automatize o seu trabalho com 1 clique.

Blaze - Crie conteúdos na metade do tempo

Dashtoon - A melhor IA para criar quadrinhos

Lipdub by Captions - Dubla e sincroniza seus vídeos para qualquer língua

Typeframes - Gera vídeos para o seu site apenas com o link dele

adminAI -Para quem odeia se organizar

Call Zen – Conversational AI for customer success.

Superdash - Extrai dados automaticamente

TranslateVideo 2.0 - Traduz vídeos para mais de 75 línguas

Hotshot - Crie gifs de alta qualidade.

Creatormind - Chatbot para o seu blog, substack ou newsletter.

Canonica AI - Gera artigos no estilo do Wikipedia

Lensgo - Apply custom video styles to all your wonders.

Frameright - adapta a sua imagem para qualquer proporção sem perder espaço

Emojis - Create AI emojis for your projects.

Interactive Scenes by Luma AI - Você vai precisar ver para acreditar.

Photo AI Yearbook - Gera fotos vintage de álbum de escola americana

Animate Anything - Anima seus modelos em 3D

PROMPTS DA SEMANA

Chat GPT

Abaixo, colarei vários títulos de postagens de blog de um grande criador do meu nicho.

Quero que você tome esses títulos como inspiração e me dê mais 20 títulos semelhantes a esses e que possam ser reaproveitados para o meu público.

Meu público: [público]

Seus objetivos: [objetivos]

Títulos de postagens de Instagram: [títulos]Você é um redator especialista com anos de experiência e muitos seguidores no Instagram. Fornecerei um título abaixo. Em seguida, fornecerei vários formatos de tweet. Seu trabalho é fornecer 5 ideias para cada formato de tweet inspirado no título.

Título: [Insira seu título]

Formatos:

- Uma história (Qual é uma boa história para contar sobre isso?)

- Aprendizados (Quais os principais aprendizados?)

- Erros comuns (quais são alguns dos erros mais comuns?)

- Como fazer (um guia de como fazer)a man with a blue face covering his face, in the style of assemblage artist, atelier olschinsky, pencilsteampunk, artur bordalo, close-up, life-size figures, kinuko y. craft --ar 128:87 --v 5.2 a woman holding an umbrella while walking with dogs, in the style of misha gordin, atmospheric environment, henri cartier-bresson, dusty piles, 3840x2160, bengal school of art, óscar domínguez --ar 128:89 --v 5.2 O Google criou uma polêmica ao fazer com que uma de suas IAs reconhcesse alguns anos atrás um homem negro como um gorila. Você pensaria que a maneira de resolver esse problema, especialmente para um gigante da tecnologia como o Google, seria simplesmente consertar o problema, tornando o reconhecedor de imagens mais poderoso em sua capacidade de discriminar humanos de gorilas. Mas não. Em vez disso, o Google simplesmente removeu todas as referências a gorilas do reconhecedor de imagens.